使用CNN在长格式音频上提取关键词以进行特征提取

我建立了一个简单的CNN单词检测器,当使用1秒的.wav作为输入时,它能够准确地预测给定的单词。按照标准,我正在使用音频文件的MFCC作为CNN的输入。

但是,我的目标是能够将其应用于更长的音频文件并说出多个单词,并使模型能够预测是否以及何时说出给定单词。我一直在网上搜索最好的方法,但是似乎碰壁了,如果可以通过google轻松找到答案,我真的道歉。

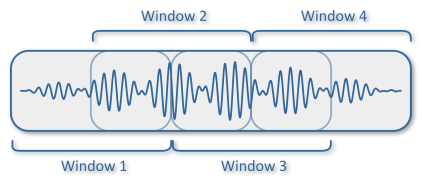

我的第一个想法是将音频文件切成1秒长的多个彼此相交的窗口-

,然后将每个窗口转换为MFCC,并将它们用作模型预测的输入。

我的第二个想法是在尝试隔离每个单词时使用开始检测,如果单词小于1秒则添加填充,然后将其作为模型预测的输入。

我要离开这里吗?任何参考或建议将不胜感激。谢谢。

1 个答案:

答案 0 :(得分:1)

将音频切入分析窗口是一种方法。通常使用一些重叠。可以先计算MFCC功能,然后使用整数帧进行分割,以使您最接近所需的窗口长度(1s)。

相关问题

最新问题

- 我写了这段代码,但我无法理解我的错误

- 我无法从一个代码实例的列表中删除 None 值,但我可以在另一个实例中。为什么它适用于一个细分市场而不适用于另一个细分市场?

- 是否有可能使 loadstring 不可能等于打印?卢阿

- java中的random.expovariate()

- Appscript 通过会议在 Google 日历中发送电子邮件和创建活动

- 为什么我的 Onclick 箭头功能在 React 中不起作用?

- 在此代码中是否有使用“this”的替代方法?

- 在 SQL Server 和 PostgreSQL 上查询,我如何从第一个表获得第二个表的可视化

- 每千个数字得到

- 更新了城市边界 KML 文件的来源?